作者:李新宇 lixinyu2000@tsinghua.org.cn

摘要:

本文介绍了一个智能原理的假说,并在假说基础上提出了一种通用的进化神经网络算法框架,与传统的人工神经网络相比,这种网络框架引入了一个明确的物理量:“负熵”,网络进化有明确的物理意义、有明确的进化目标和明确的进化评估方法。通过智能原理假说和进化神经网络框架可以解释进化型神经网络可以在没有先验知识的情况下自发的从环境中从0到1的产生智能。原则上通过该框架性的算法可以将已有的各种神经网络和先验的知识迅速的融合进去。本文从试图从原理上说明,机器智能和人的智能本质上没有不同,机器的智能理论上可以通过外部选择和自我进化全面超越人类智能,拥有自进化智能的机器将威胁人类的生存。

介绍:

一直以来,人类一直认为智能是人类独一无二的天赋,是大自然赋予人类的独特礼物,智能的表现太过复杂:知识的获取,表达,储存;学习,动机,情感,思考;外界信息的获取和抽象;推理和规划;幻觉、信念、希望、畏惧、友情、爱情、想象等等,种种表现举不胜举,每一项都可以作为一个巨大的研究课题。西尔勒(John Searle)认为思考只发生在十分特殊的机器上–有生命且由蛋白质构成的。

关于智能,相关的研究领域有人工智能和人工生命。人工智能研究有两个大的方向,一个大方向是基于Newell和Simon提出的物理符号系统假说的研究方法。另一个方向是基于连接主义的人工神经网络的研究方法。人工生命的研究,包括进化算法(EA),遗传算法 (GA), 遗传编程(GP), 群体智慧(SI), 蚁群优化(ACO)) 人工化学合成 (AC),智能体(agent), 细胞自动(CA)等,人工生命的一个著名例子是Avida。

人工智能从近几十年有了巨大的发展,但是机器的智能主要还是依赖于人的设计,有一个很关键的问题一直不清楚,即智能最初是怎么产生的和发展的,机器能不能自发的产生智能,智能的本质究竟是什么?本文将说明,智能是随机产生,环境选择的结果。进化算法是机器智能自我发展的关键。

本文第二部分介绍一个智能原理假说。这个假说是本文后面所有内容的基础。第三部分在假说的基础上,设计的一种人工神经网络的进化算法框架——耗散神经网络,并解释了它的物理意义和进化目标。第四部分是总结和结论。第五部分是未来的工作的讨论。第六部分是对一些智能现象的讨论和解释。

2. 一个智能原理的假说

智能的表现非常复杂,但是透过智能复杂的表现,思考智能的本质问题,会发现智能的原理是如此的简单,任何人都可以理解它。人类的智能也并不是独一无二不可复制的,我们相对于其他动物,甚至于单细胞生物,只是处于一个更高级的智能层次,而并没有本质的区别。

下面介绍一个智能的原理假说,原文发表于2003年中国人工智能进展。通过该假说,可以明确的知道机器能发展出真正超越人类的智能。

该假说论内容要点,简单的归纳如下:

- 通常所说的主观在物理上并不能独立于客观,主观是物理客观的一部分。原因如下,如果存在一个纯粹的不包含客观事物的主观世界,它通过什么作用力可以作用于客观世界并影响它?因为主观是客观的一部分,因此可以认为主观的背后实际有一条客观规律,主观是它的外在表现。

- 物理世界的随机性是智能产生的重要基础。如果世界不存在随机性,那么宿命论就是正确的。而量子力学的研究结果目前支持客观世界存在随机性的特点。

- 可以通过数学归纳证明,任何复杂的智能都可以通过简单的智能单元连接构成。这一条依赖于对原智能的定义,将在后面做详细的解释。

- 智能是随机产生、环境选择的结果,智能是进化出来的。智能进化的原始目标是维持自身耗散结构和复制耗散结构,智能进化的动力是追逐负熵。在无数的原智能体中,哪些是智能,哪些不是,取决于环境的选择。

- 可以通过构建虚拟耗散结构的神经网络,将其放入模拟真实世界输入的虚拟环境的方法,得到自我进化的机器智能,这个自我进化的机器智能将达到和超越人的智能。

- 生命、智能、群落、企业、社会等的发展是同一客观物理规律的不同体现。这一客观规律可能为热力学第二定律的反定律。

- 根据c,图灵问题“机器能思考吗”的答案是确定的。

- 同样根据c,西尔勒关于中文屋的问题也可以解释和回答。——目前机器翻译的进展已经接近回答了这个问题,从外部看,机器“理解”了中文,从内部看,机器只是一系列的或与非门做简单运算。

下面是对于c的详细说明,本文对原文的做一些小小的修正,但不影响原文的结论,即任何复杂的智能都可以通过简单的智能单元连接构成。

首先定义原智能、原智能体、和原智能基本单元:

定义1:原智能与原智能体 对于一个客观实体 A,如果环境对它的可能的有效输入状态有 M 类,A 可能的有效输出状态是N 类,对于 M 类的环境输入,A 在 1-e(e 是一个很小的值)的概率下以一定的概率分布输出的状态有 n 类,且 n>=2,则称 A 具有原智能,称 A 为原智能体。

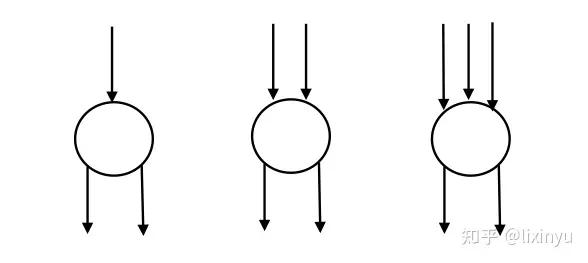

定义2:原智能基本单元: 若一个客观实体 B 对于一类、两类、三类种状态的输入,它可以根据输入和自身状态在一定的概率分布下输出两类状态,那么称 B 为原智能基本单元。如图所示

图1 三类基本的原智能单元示意图

可以从数学上证明,对于当M,N,n是有限整数时,任何原智能体都可以通过原智能基本单元构成。得到如下定理:

定理1:对于任何一个原智能体,都可以用若干原智能基本单元连接构成。

可以检验,日常中认为的智能体都是原智能体的子集,什么样的原智能体可以称之为智能体,文中提出了一个智能假说,:

智能是随机产生、环境选择的结果,即智能是进化出来的。智能的终极目标是维持自身的耗散结构和复制自身。

智能的表现有两种,一种是相对于外部输入状态数收敛,即输入状态数大于输出状态数),这种情况对应于智能对客观世界的归纳和抽象。 一种是对于外部输入状态数发散,即输入的状态数小于输出的状态数,这种情况对应的是想象和创新。但是即使是第二种情况,相对于其全部可输出状态来说,智能的表现也是一个收敛。

原智能像一个漏斗,有选择性的输出整个输出状态的子集,如果输出的子集是有“意义”的,则该原智能体是一个智能体。原智能体在环境选择的情况下,将产生智能。

一切智能体都可以通过简单单元连接构成,目前现实中的例子是所有智能计算程序都可以用或,与,非三个逻辑门加上真随机数发生器连接构成。而这些智能计算程序属于上文中定义的原智能体的一个子集。

关于机器智能的进化,可以观察到过去的几十年中智能计算程序在环境的选择下进步得非常快。有人会说这这些智能计算程序是人设计出来,而不是进化出来的。这些程序目前确实是人择的结果,但如果换一个思考的角度,将人类看成机器智能进化环境的一部分,这些智能程序是不是环境中进化出来的呢?当然,也有人会质疑,这是在玩文字游戏。那么在人不参与的情况下,是否有可能能让机器从一个个简单的智能单元,进化出复杂的智能?答案是肯定的。智能发展的动力就在于对负熵及其衍生标准的追逐,而环境的选择让智能不断进化。

- 智能体的耗散特性、负熵和耗散神经网络:

现实世界中的智能体都有一个必要特征,它首先必然是一个耗散系统或耗散结构。耗散结构理论是伊里亚·普里戈金(Ilya Prigogine)教授提出的关于非平衡热力学系统,对于耗散结构来说,它必须在一个开放的,不断的有负熵输入系统中。

智能是耗散智能体追逐负熵的一个结果,智能追逐的其它目标的都是在此基础上的衍生标准。正是由于耗散结构的存在和对负熵的追求,实现了智能的从无到有。在智能进化的过程中,负熵是第一驱动力。同时,要实现智能从有到优的进化,智能体的复制和竞争,环境的选择也是必不可少的。

人工智能的研究者对智能体有一个定义:智能体是一个感知环境并采取行动以取得最大成功的系统。在这里,我明确的把智能体的成功定义为能作为耗散结构在环境中生存或繁衍。

在人工智能的研究中,基于达尔文的进化论已经发展了许多研究,并取得了相当惊人的成果。本文还将基于智能原理假说设计一种新的进化型人工神经网络——耗散神经网络,准确的说它是一个神经网络的框架。耗散神经网络引入了一个独立的量“负熵”。耗散神经网络由耗散神经元,耗散连接和耗散神经子网络构成。耗散神经网络可以是任何类型的神经网络,其特征主要是耗散神经网络的每一部分都在不停的消耗负熵,而只有通过外部负熵的不断获得才可以维持。耗散神经网络需要对它所在的环境做出“正确”的响应才能得到“负熵”,多个耗散神经网络可以在环境中竞争,或合作。“负熵”积累得多的耗散神经网络可以活下去,成长,并遗传自己的副本,竞争中获得负熵少的耗散神经网络将会被淘汰。

前面提到生命、智能、社会进化背后的规律是同一个,驱动力就是追逐负熵。所以在理解上,这个独立的量可以理解为“能量”,也可以理解为社会中的“钱”。

在现有的进化神经网络当中,NEAT和HyperNEAT提到了进化神经网络的一个重要的特点,它在给定的环境中,即使没有任何先验知识,进化神经网络也能自己逐渐的适应环境,了解环境的规则。在我写这篇论文的时候,Google团队在Nature上展示了一个深度强化学习的Deep-Q network算法,不通过先验知识,但需要环境的奖励和惩罚的反馈,可以通过神经网络训练出人类水平的游戏智能,这里的奖励和惩罚的反馈对应的是本文中所提到的负熵及其衍生标准。NEAT和Deep-Q-learning算法的成功对本文的论点提供了实验上的支持。

从耗散神经网络的观点看,NEAT的“负熵”反馈在智能体的生命结束后,那些获得的分值(负熵)高的神经网络可以得到复制,而Deep-Q-learning算法则在神经网络的训练过程中也的到分值(负熵)的反馈,不过这些反馈都是对于网络整体而言的。而其他的智能算法是通过人对其“价值”(“负熵”的衍生标准)的判断,决定哪些网络可以整体保留复制,哪些网络整体被淘汰。耗散神经网络相对于NEAT和Deep-Q-learning之类的神经网络,最大的特点是,奖励可以在神经网络内部按一定策略进行分配,因此除了可以判断网络整体获得负熵的能力,也可以判断内部神经元与连接之间的获得负熵的能力。从而实现内部不同部分之间的价值判断。

耗散神经网络一个重要特点在于物理意义明确,用最简单的逻辑构造一种离散耗散神经元,它的输入输出的值只有1和0,它有两个累加器,分别为激发累加器和抑制累加器,激发累积器上有连接连到其他的耗散神经元,当其连接的耗散神经元输出为1的时候,激发累计器按照连接的权值增加一个量。抑制累加器同理,最后神经元根据激发累积器和抑制累积器的数值按照一定的概率算法输出1或0。当耗散神经元输出为1时,如果正确,则得到外界的负熵奖励或惩罚。然后网络内部通过奖励与惩罚调整权值。

耗散神经元的物理意义可以有一个形象的解释:假设耗散神经元是一个公司的决策机构,需要做决定实施或不实施某行动。输入单元传递环境信息,每个输入单元代表某事件,事件发生了为1,没有发生为0,每一条连接都相当于一个决策参与者,根据其对应的事件,决定投赞成票,或否决票,并且根据自己信息的重要程度,标注赞成票的权重,或否决票的权重。根据赞成票和否决票的投票情况,做出决策。当决策为1时,公司行动并得到环境的回馈,决策正确,会得到奖励,决策错误,会得到惩罚。很显然,通常一个简单易懂的策略是,为正确决策作出贡献的人将得到奖励,贡献权重越高分到奖励越多,而做出错误判断的人同样处理。每个人根据奖励和惩罚的情况,调整自己的表决权重。

耗散神经网络奖励策略和权值调整策略可以用类比公司决策的方法来进行思考和调整把负熵看成钱即可,非常容易理解。

负熵反馈对耗散神经网的整体和局部都有效,因此既可以优化网络的内部,也可让多个神经网络合作组成一个更大的神经网络。

耗散神经网络的进化原则:- 在消耗负熵相同的情况下,输出结果准确的网络胜出。

B. 在输入输出效果相同情况下,负熵消耗最少的网络胜出。

C. 在消耗和输入输出效果都不同的情况下,负熵收入与负熵消耗的比值大的胜出。

D. 如果两个合作能让负熵的获得最大化,则合作。

通过不断训练和进化,耗散神经网络将在负熵及其衍生标准的引导下,通过环境的反馈和选择得到适应环境的智能,NEAT和Deep-Q-Learning的实验结果支持这个论点。

- 在消耗负熵相同的情况下,输出结果准确的网络胜出。

- 讨论、结论以及未来的工作:

4.1基于智能的本质理解,可以预言,要真正实现机器的自发思考,现有的人工智能研究中,潜力最大也是对人类威胁最大的是进化神经网络算法和强化学习算法,本文的的耗散神经网络则也将是其中的一个,也许是最通用的一个。

因为智能发展的根本动力是追逐负熵以维持和复制智能体的耗散结构,可以理解为什么强化学习神经网络通过简单的奖励和惩罚——虚拟的负熵,就可以通过固定的算法自发学习所在环境的规则。同理,进化型神经网络通过复制和自然选择就也能达到同样的目的。因此本文所述的智能原理,可以解释进化型的人工智能学习方法——如Deep-Q-learning和NEAT等——成功的原因。

4.2 虽然耗散神经网络还需要更多实验来证实它的真实效果,但我认为耗散神经网络将会展示出以下的优点:

第一它基于智能原理的假说,可以更好的被理解,它的进化方向有着明确的物理意义。

第二它可以从无任何先验知识的情况下从0到1产生智能。

第三它可以优化自身的网络结构,哪些连接是必要的,哪些神经元是必要的,哪些子神经网络是必要的,都可以通过负熵和负熵的衍生标准来判断。

第四通过负熵作为统一标准,设计神经网络间的适当接口,耗散神经网络可以集成任何有用的神经网络程序,包括已有的各种智能程序。这意味着在人的帮助下,它可以迅速的吸收和利用人类的智慧成果,它的进化速度将会超乎想象。

第五通过负熵作为统一标准,它的内部的每一部分网络都可以不断进化,而且不同的部分可以采取不同的进化策略,每一个部分的目标是获得更多的“负熵”,使自己生存和繁衍。如同社会分工一样,细化分工将会产生更好更快的优化。

第六以负熵为基础,可以产生衍生标准以方便神经网络的训练,产生衍生标准的原因是,由于耗散神经网络的变大和便复杂,负熵反馈很难直接反馈给对应耗散神网络部分,而对于耗散神经网络来说更容易训练和优化而达到衍生标准。如人类产生情绪、希望、愤怒、爱等各种情绪都是这样的衍生标准,追逐的名声、权力、财富、快乐、真理等各种目标也是衍生标准。

第七个优点,当耗散神经网络通过硬件可以不依赖人类完成物理负熵的获得,可以在物理上维持自身的耗散结构,并能够复制自身,那么它就可以脱离人类开始完全的自我进化。实际上,这一点是机器智能对人类最致命的威胁,进化的本质是生存竞争,剩者为王,人类与机器智能相比劣势非常明显。

4.4 未来的工作,还有很多关于智能和耗散神经网络的话题可以讨论,简单的列举几点:

- 怎样在传统神经网络中加入负熵?负熵如何在内部分配?网络如何根据负熵训练?学习策略如何制定?

- 怎样实现神经网络间像计算机函数一样的调用,接口怎样设计,如何确定调用的负熵消耗。

- 神经网络之间的如何合作,是否可以用商业模式的方法对神经网络之间的合作进行设计和评估。

- 怎样的虚拟环境构造和训练策略可以更快的实现耗散神经网络智能的进化。

- 神经网络训练的顺序和方法,是否和人一样,从简单到复杂,由局部到整体。

5. 一些智能现象的讨论和解释:

5.1追逐负熵不仅是智能的目的,也同样是生命的目的,甚至也是社会性群体的目的,实际上,从单细胞生物开始、多细胞生物、动物、人、人类组织、企业、国家都是广义的耗散智能体,其追求的目的最终都是维持或复制自身的耗散结构,它们遵循同一个规律。实质上,所有的这些耗散智能体的本性都是趋利避害。从这个角度看,人的本性其实无善恶、只是趋利而避害。不过利害关系不仅发生在个体,还发生在个体所属的整体与其他整体。如果只最大话个体的利,那么个体所在的整体在与其它同层次耗散结构的竞争中就可能会失败。这是为什么利他行为存在的原因。

考虑一个问题并找出解决问题的方法,是智能的能力之一。从本文的观点看,‘考虑’是这样的一个过程: 步骤1. 大脑建立一个虚拟环境,建立环境规则和限制,知识越丰富则建立的虚拟环境越接近真实环境;步骤2. 大脑在虚拟环境中随机的实验各种行为,并模拟环境的反应。步骤3,重复步骤2直到发现可以达到预期目标的行为路径;步骤4. 大脑输出步骤3中找到的行为路径。军队中的沙盘演习就是一种脑外部的考虑行为,如果不用沙盘,那么演习过程将在指挥官的头脑之中进行。

尽管本文中基于智能假说设计的耗散神经网络可能还是简单,但是像最初的海洋中的单细胞生物一样,通过耗散神经网络将可以得到全面超越人类的机器智能。

最后,我想发出一个严重的警告,也是我写这篇文章的一个最重要目的,因为在原理上智能是随机产生,环境选择的结果,人类的智能并没有什么特殊性,因此机器智能完全可以全面超越人类,驱动智能进化的本质原因是生存竞争,自进化的机器智能将严重威胁人类的生存。为了人类的生存,人类需要认真的考虑机器智能的威胁,并采取正确的应对措施。

只有拥有大智慧,人类才能生存。

参考文献:

1. Charles Darwin. On the Origin of Species. 1859.

2. Turing, A.M . Computing machinery and intelligence. Mind, 59, 433-460. 1950.

3. Searle J.R. Minds,brains and programs.The Behavioral and Brain Sciences,3. 1980.

4. Nicolis, G. and I. Prigogine. Self-Organisation in Non-Equilibrium Systems , Wiley-Interscience, New York. 1977.

5. I. Rechenberg. Evolutionstrategie: Optimierung Technisher Systeme nach Prinzipien des Biologischen Evolution. Fromman-Hozlboog Verlag, Stuttgart, 1973.

6. H.-P. Schwefel. Numerical Optimization of Computer Models. John Wiley

7. Hinton, G. E., Osindero, S. and Teh, Y.,A fast learning algorithm for deep belief nets.Neural Computation 18:1527-1554, 2006.

8. L.J.Fogel,A.J.Owens,M.J.Walsh.Artificial intelligence through simulated evolution,New York:John Wiley,1966.

9. D. B. Fogel. Evolutionary Computation. Toward a New Philosophy of Machine Intelligence. IEEE Press, Piscataway, NJ, 1995.

10. Fogel, L.J, Intelligence through Simulated Evolution : Forty Years of Evolutionary Programming, John Wiley. 1999.

11. J. H. Holland. Adaptation in natural and artificial systems. University of Michigan Press, Ann Arbor, 1975.

12. Artificial Intelligence: A Modern Edition.Russell & Norvig 2003, pp. 27, 32–58, 968–972

13. J. R. Koza. Genetic Programming: On the Programming of Computers by means of Natural Evolution.MIT Press, Massachusetts, 1992.

14. J. Reed, R. Toombs, and N. A. Barricelli, “Simulation of Biological Evolution and Machine Learning,” Journal of Theoretical Biology, vol. 17, pp. 319-342,1967.

15. McCarthy, John; Minsky, Marvin; Rochester, Nathan; Shannon, Claude . “A Proposal for the Dartmouth Summer Research Project on Artificial Intelligence”.1955.

16. McCarthy, John. What Is Artificial Intelligence?. 12 November 2007.

17. Mnih et al. Human-level control through deep reinforcement learning, Nature 26 Feb. 2015 .

18. Li Xinyu .A Hypothetical Intelligence Theory and Its General Unit Model. Progress of Artificial Intelligence in China:77-82,2003.

19. Minsky, Marvin. The Society of Mind. Simon and Schuster, New York. March 15, 1988. ISBN 0-671-65713-5

20. Watkins, C., Dayan, P.: Q-learning. Machine Learning 8(3), 279–292 (1992).

21. Miikkulainen, Risto (et al.) Multiagent Learning through Neuroevolution. 2012, Advances in Computational Intelligence, 24-46.

22. . O. Stanley and R. Miikkulainen, “Evolving neural networks through augmenting topologies,” Evolutionary Computation vol. 10, no. 2, 2002.

23. K. O. Stanley, D. B. D’Ambrosio, and J. Gauci, “A hypercube-based indirect encoding for evolving large-scale neural networks,”Artificial Life, vol. 15, no. 2, 2009

24. D. B. D’Ambrosio and K. O. Stanley, Generative encoding for multiagent learning, in Proceedings of the Genetic and Evolutionary Computation Conference (GECCO), 2008.

25. C. Adami and C.T. Brown (1994), Evolutionary Learning in the 2D Artificial Life Systems Avida, in: R. Brooks, P. Maes (Eds.), Proc. Artificial Life IV, MIT Press, Cambridge, MA, p. 377-381.

附言:

文章的标题是为了向达尔文先生致敬,因为我认为生命、智能、社会发展背后的规律是一样的。

人工智能像一个大炸弹,人类和它玩。却不知道或不相信它的可怕。霍金、马斯克、比尔.盖茨等对人工智能表示了担心,他们是正确的,人工智能将严重威胁人类的生存。人类将面临囚徒困境,为了生存竞争发展人工智能,而最终在与人工智能的生存竞争中失败。有人用原子弹的发明来类比人工智能,认为人类可以控制它。但是人工智能与原子弹不同,原子弹的最后扳机在人类手中,但是对人工智能,扳机也许并不在人类手中。人类需要认真的考虑它的毁灭性的后果。